OpenAI ha dado un movimiento estratégico inesperado: el 14 de abril de 2026 anunció GPT-5.4-Cyber, una variante de GPT-5.4 especializada en ciberseguridad defensiva. A diferencia del modelo estándar, este modelo puede ingeniería inversa de binarios, analizar malware y resolver consultas de seguridad que los modelos convencionales rechazaban por sus filtros. No está disponible para todos: requiere acceso verificado a través del programa Trusted Access for Cyber (TAC). Te contamos qué es, quién puede usarlo y por qué es una jugada directa contra Anthropic y Claude Mythos.

¿Qué es GPT-5.4-Cyber?

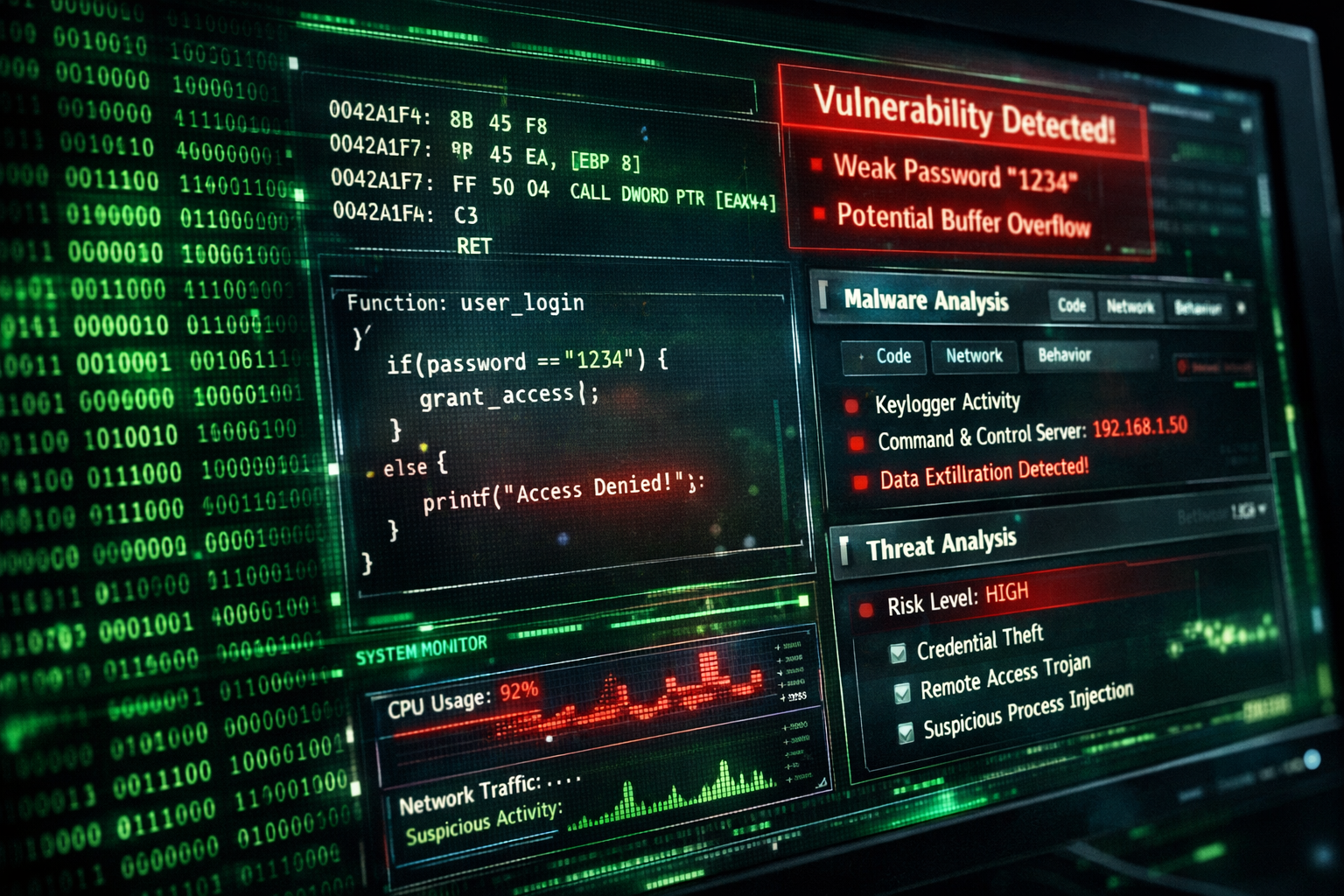

GPT-5.4-Cyber es una versión modificada de GPT-5.4, el modelo base de OpenAI lanzado el 2 de abril de 2026, entrenada específicamente para ser "cyber-permissive": permite consultas de ciberseguridad que el modelo estándar rechazaría.

El problema que resuelve es real: los investigadores de ciberseguridad llevaban meses quejándose de que GPT-5 y versiones anteriores se negaban a responder preguntas legítimas de seguridad por sus filtros de contenido. Analizar malware, explicar técnicas de ataque o revisar binarios sospechosos activaba rechazos automáticos que frenaban el trabajo defensivo.

GPT-5.4-Cyber baja ese umbral de rechazo para casos de uso verificados de defensa cibernética, permitiendo a los profesionales hacer su trabajo sin la fricción artificial del modelo base.

Capacidades: qué puede hacer que GPT-5.4 estándar no puede

La diferencia clave está en los límites de rechazo y las capacidades técnicas especializadas. Aquí van los casos de uso que GPT-5.4-Cyber desbloquea:

- Ingeniería inversa de binarios: Analizar ejecutables compilados sin acceso al código fuente

- Análisis de malware: Descomponer código malicioso para entender su funcionamiento

- Búsqueda de vulnerabilidades: Identificar fallos en código para parchearlos (CVEs defensivos)

- Generación de reglas defensivas: YARA, Snort, Sigma rules

- Red team simulation: Simulación controlada de ataques para reforzar defensas

- Análisis forense: Revisión de logs, tráfico de red y artefactos digitales

- Exploit research: Estudio de exploits existentes para desarrollar mitigaciones

Ingeniería inversa de binarios: la novedad clave

De todas las capacidades, la ingeniería inversa de binarios es la más revolucionaria. Hasta ahora, analizar un ejecutable sospechoso requería herramientas especializadas (IDA Pro, Ghidra, Binary Ninja) y años de experiencia. GPT-5.4-Cyber democratiza parcialmente esta tarea.

Cómo funciona

- Cargas un binario compilado (ELF, PE, Mach-O)

- GPT-5.4-Cyber lo analiza, identifica funciones, llamadas a sistema y patrones sospechosos

- Genera un informe en lenguaje natural de lo que hace el binario

- Detecta posibles indicadores de compromiso (IoCs)

- Sugiere contramedidas específicas

Esto es especialmente valioso para equipos de Security Operations Center (SOC) que reciben alertas sobre ejecutables desconocidos y necesitan triaje rápido.

Cómo conseguir acceso: Trusted Access for Cyber

GPT-5.4-Cyber no está disponible para el público general. OpenAI ha implementado un sistema de acceso escalonado llamado Trusted Access for Cyber (TAC) con verificación de identidad.

Tiers de acceso

| Tier | Quién puede acceder | Cómo |

|---|---|---|

| Individual defenders | Profesionales verificados | chatgpt.com/cyber + verificación ID |

| Teams | Equipos SOC/pen-testing | Contactar representante OpenAI |

| Enterprise | Empresas grandes | Acuerdo comercial + background check |

| Critical infrastructure | Defensores de infraestructura crítica | Proceso especial con gobierno |

Proceso de verificación

Para acceder como profesional individual:

- Ir a chatgpt.com/cyber

- Verificar identidad con documento oficial

- Proporcionar credenciales de seguridad (certificaciones: OSCP, CISSP, CEH, SANS)

- Aceptar términos de uso restrictivos de TAC

- Esperar aprobación (24-72 horas)

La batalla OpenAI vs Anthropic: Cyber vs Mythos

El lanzamiento de GPT-5.4-Cyber no es casualidad: llega una semana después de que Anthropic anunciara Claude Mythos, su propio modelo para ciberseguridad dentro del Project Glasswing. Es una jugada directa para no ceder este mercado emergente.

Comparativa rápida: Cyber vs Mythos

| Aspecto | GPT-5.4-Cyber (OpenAI) | Claude Mythos (Anthropic) |

|---|---|---|

| Fecha lanzamiento | 14 abril 2026 | 7 abril 2026 |

| Base | GPT-5.4 | Claude Opus 4.6 (probablemente 4.7 pronto) |

| Reverse engineering | Sí, clave | Sí |

| Acceso | TAC verificado | Programa Glasswing |

| Enfoque | Defensivo amplio | Defensivo + enfoque infra crítica |

| Integración | ChatGPT + API | Claude.ai + API + partners gov |

Para más contexto sobre el panorama IA actual, consulta nuestra comparativa de modelos IA abril 2026. También puedes leer sobre el filtrado inicial de Claude Mythos que ya cubrimos.

Riesgos y controles: la preocupación dual-use

Todo modelo "cyber-permissive" tiene un problema inherente: las mismas capacidades que ayudan a defender pueden usarse para atacar. OpenAI ha implementado varios controles:

Controles implementados

- Verificación obligatoria de identidad: Nada de cuentas anónimas

- Logs detallados: Todas las consultas quedan registradas

- Auditorías periódicas: OpenAI revisa uso para detectar abuso

- Revocación rápida: Acceso retirado inmediatamente ante uso incorrecto

- Limitaciones técnicas: Ciertos tipos de generación siguen bloqueados (malware directo, exploits zero-day contra targets específicos)

- Cooperación con autoridades: Denuncia de intentos maliciosos claros

Preocupaciones de la comunidad

No todo el mundo está convencido. Críticas comunes:

- ¿Suficiente verificación? Un certificado OSCP no garantiza intenciones éticas

- Posible abuso por insiders: Empleados deshonestos en empresas con acceso

- Brecha competitiva: Solo empresas grandes y occidentales tendrán acceso

- Escalada de arms race: Los atacantes también tendrán sus propios modelos "cyber-permissive"

Preguntas Frecuentes

¿Cualquiera puede usar GPT-5.4-Cyber?

No. Requiere verificación a través de Trusted Access for Cyber (TAC). Necesitas demostrar identidad y credenciales de profesional de ciberseguridad. El proceso tarda entre 24 y 72 horas.

¿Cuánto cuesta GPT-5.4-Cyber?

OpenAI no ha publicado precios oficiales al público general, ya que el acceso es restringido. En el tier enterprise, se negocia caso por caso. Se espera que sea significativamente más caro que GPT-5.4 estándar.

¿Puede hackear sistemas GPT-5.4-Cyber?

No directamente. El modelo mantiene bloqueos para ataques activos a sistemas específicos. Sí puede analizar y explicar técnicas de ataque de forma conceptual, o revisar código para identificar vulnerabilidades defensivamente.

¿Es mejor que Claude Mythos?

Demasiado pronto para decirlo. Ambos modelos son muy recientes (menos de 2 semanas de vida al escribir este artículo). Las primeras pruebas sugieren que GPT-5.4-Cyber es más fuerte en reverse engineering de binarios, mientras que Claude Mythos destaca en análisis de código fuente.

¿Qué pasa si mi empresa quiere acceso?

Debes contactar con OpenAI Sales para negociar un acuerdo empresarial. Necesitarás proporcionar documentación de tu actividad, equipo de seguridad y casos de uso concretos. OpenAI hace background check antes de aprobar.

¿GPT-5.4-Cyber reemplaza a herramientas como IDA Pro o Ghidra?

No, las complementa. Las herramientas tradicionales siguen siendo imprescindibles para análisis profundo y automatizado. GPT-5.4-Cyber es ideal para triaje rápido, explicación en lenguaje natural de lo que hace un binario, y generación de reglas defensivas.

Comentarios

Inicia sesion para dejar un comentario

Acceder